ouvir o artigo

O Pulo do Gato da Intel: Como seu PC pode Rodar IA Gigante sem uma GPU Potente

Imagine ter o poder de um cérebro digital como o ChatGPT rodando diretamente no seu computador, sem depender da internet e sem precisar de uma placa de vídeo que custa o preço de um carro. Parece ficção científica, certo? Pois bem, essa realidade está muito mais próxima do que você imagina, graças a uma combinação genial de software inteligente e um “superpoder” escondido em muitos processadores modernos.

O Dilema do Gigante: Por Que a IA Pesa Tanto?

Os Modelos de Linguagem Grandes (LLMs), como o Llama 2 da Meta ou a família GPT da OpenAI, são verdadeiros titãs digitais. Seus “cérebros” são compostos por bilhões de parâmetros, que são como os neurônios e sinapses que armazenam todo o conhecimento. Para funcionar, esses parâmetros precisam ser carregados na memória, e a memória mais rápida para esse tipo de trabalho é a VRAM, encontrada nas placas de vídeo (GPUs). O problema? A VRAM é caríssima e limitada. Um modelo de médio porte pode facilmente exigir mais de 24GB de VRAM, algo que só as GPUs mais caras do mercado oferecem.

A Solução Mágica: “Emagrecendo” a IA com a Quantização

Se não podemos aumentar a memória, que tal diminuir o tamanho do modelo? É aqui que entra a quantização. Pense nela como a conversão de uma foto de altíssima resolução para um formato mais compacto, como o JPEG. Você reduz a paleta de cores e a quantidade de detalhes finos, mas a imagem principal continua perfeitamente reconhecível. Na IA, a quantização faz algo parecido: ela reduz a precisão dos números (parâmetros) que formam o modelo, fazendo com que ele ocupe muito menos espaço. Com isso, um gigante que exigia uma GPU de ponta pode, de repente, caber na RAM do seu PC.

NF4: A Dieta Inteligente para Modelos de IA

Claro, “emagrecer” um modelo de IA tem seus riscos. Uma quantização malfeita pode fazer o modelo perder sua “inteligência”. É por isso que surgiram formatos mais espertos, e o queridinho da vez é o NF4 (NormalFloat4). Ele é um tipo de dado de 4 bits especialmente projetado para ser super eficiente na compressão de modelos de IA, preservando ao máximo a informação importante. Ele funciona tão bem porque foi criado pensando na forma como os parâmetros de um cérebro digital geralmente se distribuem. É uma compressão com o mínimo de perda de qualidade.

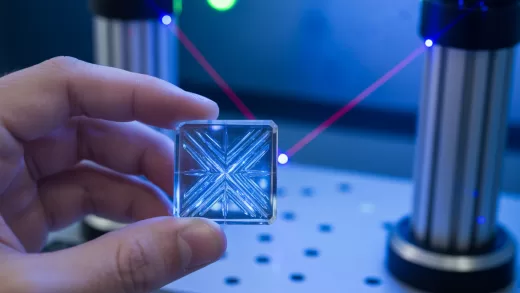

AVX-512: O “Nitro” Escondido no seu Processador

Com o modelo finalmente “magrinho” e cabendo no nosso PC, um novo problema surge: a velocidade. Para que a IA possa usar esses dados comprimidos, ela precisa descomprimi-los (um processo chamado dequantização) em tempo real. E essa descompressão pode ser lenta, tornando-se o novo gargalo do sistema. É aqui que o superpoder do seu processador entra em cena. Muitos CPUs modernos da Intel (e alguns da AMD) vêm com um conjunto de instruções chamado AVX-512. Pense no AVX-512 como uma via expressa dentro do seu processador, capaz de realizar a mesma operação matemática em um grande bloco de dados de uma só vez. É uma ferramenta absurdamente poderosa para tarefas repetitivas, como… adivinhe? Descomprimir dados!

A Faísca da Genialidade: Juntando NF4 e AVX-512

A grande notícia é que desenvolvedores criaram uma forma incrivelmente rápida de realizar a dequantização de modelos em formato NF4 usando o poder do AVX-512. Eles descobriram um “truque” que usa as instruções específicas do AVX-512 para acelerar o processo de forma brutal. O resultado? A velocidade de inferência (o tempo que a IA leva para dar uma resposta) em um modelo quantizado com NF4 rodando em um CPU com AVX-512 pode ser até 46 vezes mais rápida do que as implementações anteriores. Isso mesmo, quarenta e seis vezes!

Como Funciona na Prática?

Sem mergulhar em um mar de código, a mágica acontece ao tratar a descompressão como um quebra-cabeça de busca em tabelas. O AVX-512 consegue buscar e rearranjar as peças desse quebra-cabeça (os dados descomprimidos) de maneira massivamente paralela. Ele pega os pequenos dados de 4 bits, encontra seus correspondentes de maior precisão em uma tabela de consulta e os monta na ordem correta, tudo em uma fração do tempo que um método convencional levaria. É a força bruta inteligente do processador sendo usada em sua máxima capacidade.

O Que Isso Significa Para Você, na Prática?

Essa inovação é um divisor de águas. Ela democratiza o acesso à inteligência artificial de ponta. Veja o que muda:

- Menos dependência de GPUs caras: Você poderá rodar modelos de IA poderosos para tarefas de programação, escrita e análise de dados diretamente no seu notebook ou desktop.

- Privacidade e velocidade: Executar a IA localmente significa que seus dados não saem da sua máquina, e a resposta é quase instantânea, sem depender da sua conexão com a internet.

- Novas possibilidades: Abre as portas para que desenvolvedores criem aplicativos mais inteligentes que rodam de forma eficiente em hardware comum, integrando IA avançada em softwares do dia a dia.

Estamos testemunhando uma reviravolta emocionante. Por muito tempo, as GPUs foram as rainhas absolutas do universo da IA. Agora, graças à otimização inteligente de software e ao poder oculto dos processadores, a CPU está voltando com tudo para o jogo, prometendo um futuro onde a inteligência artificial de ponta é uma ferramenta acessível a todos.