O ChatGPT Guarda Suas Conversas? Decisão Judicial Polêmica Agita o Mundo da IA

Você já parou para pensar no que acontece com todas as perguntas, ideias e desabafos que você digita na caixinha de texto do ChatGPT? É quase como conversar com um amigo muito inteligente, sempre disponível. Mas, para onde vão essas conversas? Elas simplesmente desaparecem no éter digital? Uma recente decisão judicial em São Francisco, nos Estados Unidos, jogou uma luz intensa e um tanto desconfortável sobre essa questão, colocando em rota de colisão os conceitos de privacidade do usuário, a busca por justiça e o funcionamento das gigantes de tecnologia como a OpenAI.

A polêmica não é pequena e as implicações são enormes, tocando num ponto sensível para todos nós que usamos essas novas ferramentas de inteligência artificial. Afinal, nossas interações com a IA são realmente privadas? Prepare-se, porque vamos mergulhar fundo nesse caso para entender o que está em jogo e o que isso significa para o futuro da nossa vida digital.

O Coração da Disputa: Privacidade vs. Justiça

Para entender a decisão, precisamos voltar um pouco. Tudo começa com um processo de ação coletiva movido contra a OpenAI, a empresa por trás do ChatGPT. Os autores da ação acusam a companhia de práticas, no mínimo, questionáveis. A principal alegação é que a OpenAI teria “raspado” uma quantidade colossal de dados da internet – incluindo informações pessoais, posts em redes sociais, artigos e muito mais – sem a permissão dos seus criadores, tudo para treinar seus modelos de linguagem, como o GPT-3.5 e o GPT-4. Basicamente, a acusação é de que a IA foi alimentada com uma dieta de dados que não deveria ter consumido.

Como em qualquer batalha judicial, os advogados dos queixosos precisam de provas para sustentar suas alegações. E onde eles acreditam que podem encontrar a “arma do crime”? Exatamente: nos logs de conversas dos usuários do ChatGPT. A teoria deles é que, ao analisar o que as pessoas perguntam e como o ChatGPT responde, eles podem demonstrar como o modelo utiliza as informações que supostamente foram obtidas de forma indevida. Por isso, eles pediram ao juiz que ordenasse à OpenAI a preservação desses registros, impedindo que fossem apagados.

Entra em Cena um “Guardião da Privacidade”

É aqui que a história ganha um novo e importante personagem: o EPIC (Electronic Privacy Information Center), uma renomada organização sem fins lucrativos dedicada à defesa da privacidade digital. O EPIC entrou no caso não como parte da acusação ou da defesa, mas como um “amicus curiae”, uma expressão em latim que significa “amigo do tribunal”. Em termos simples, eles ofereceram sua expertise para ajudar o juiz a entender as implicações mais amplas da sua decisão.

A argumentação do EPIC foi forte e direta. Eles afirmaram que forçar a OpenAI a reter indefinidamente os históricos de chat de milhões de usuários para um processo judicial era, na prática, uma forma de vigilância em massa. O raciocínio era que o sistema judicial, um braço do governo, estaria obrigando uma empresa privada a coletar e armazenar dados em uma escala gigantesca, transformando o ChatGPT em uma ferramenta de monitoramento involuntário. A comparação era com programas de vigilância governamental que coletam dados de telefone e internet, algo que sempre gerou enormes debates sobre direitos civis.

Vigilância em Massa ou Procedimento Padrão?

O palco estava montado para uma decisão marcante. De um lado, a necessidade de provas para um processo sobre privacidade. Do outro, o alerta sobre a criação de um precedente perigoso de vigilância. O juiz federal Vince Chhabria, responsável pelo caso, ouviu os argumentos e tomou sua decisão. E ela foi contrária ao que o EPIC defendia.

O juiz rejeitou a ideia de que a ordem de preservação dos logs constituía vigilância em massa. Em sua análise, ele fez uma distinção crucial. Para ele, uma coisa é o governo, por conta própria, exigir dados em massa para fins de segurança nacional ou investigação criminal. Outra, completamente diferente, é um juiz ordenar a preservação de evidências em um processo civil entre partes privadas. Isso, segundo ele, é um procedimento padrão, conhecido como “discovery” (descoberta de provas), e acontece em milhares de casos todos os dias. A diferença, aqui, é apenas a escala e a natureza tecnológica dos dados.

O juiz Chhabria ainda apontou o que chamou de “ironia” na posição dos queixosos e do EPIC. A ação judicial foi iniciada justamente para proteger a privacidade das pessoas. Agora, para provar seu ponto, eles precisavam acessar dados que, por sua vez, também levantam preocupações de privacidade. É um paradoxo que ilustra a complexidade de regular a tecnologia no século XXI.

O Que Isso Significa para Você, Usuário do ChatGPT?

Ok, a linguagem jurídica pode ser confusa. Vamos traduzir. Essa decisão significa que o governo vai ler suas conversas sobre receitas de bolo ou planos para o fim de semana? A resposta curta é: não. A ordem judicial não dá ao FBI ou a qualquer outra agência governamental acesso irrestrito aos seus chats. Os dados preservados seriam acessados, em tese, apenas pelos advogados envolvidos no caso, e mesmo assim sob ordens de proteção estritas para garantir a confidencialidade e o uso limitado apenas para o processo.

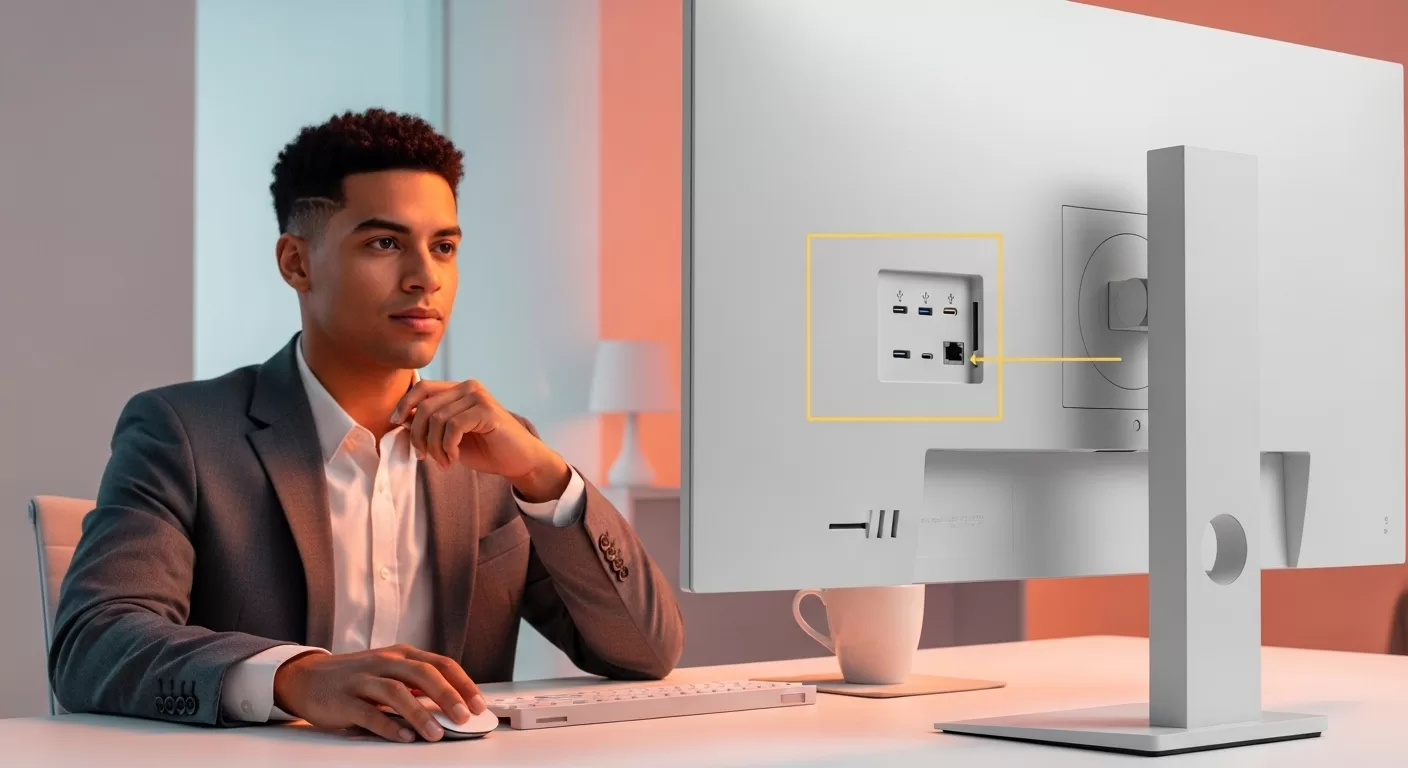

Além disso, é importante esclarecer um ponto: a OpenAI já retém os logs de conversa por um período (geralmente 30 dias), a menos que o usuário opte por desativar o histórico. Essa retenção é feita para monitorar abusos e aprimorar o serviço. A ordem judicial, portanto, não cria uma nova forma de coleta de dados, mas exige que a empresa não apague os dados que ela já coleta, para que sirvam de prova. Vale lembrar que os usuários têm a opção, nas configurações do ChatGPT, de desativar o histórico de chat e impedir que suas conversas sejam usadas para treinar os modelos futuros da OpenAI, garantindo uma camada extra de privacidade.

O Futuro da Privacidade na Era da Inteligência Artificial

Ainda que não seja o cenário de “vigilância total” que alguns temiam, a decisão do juiz Chhabria abre um precedente importante e joga luz sobre questões fundamentais com as quais teremos que lidar cada vez mais. As linhas que separam os dados privados, a propriedade intelectual e as evidências em um processo legal estão se tornando incrivelmente borradas.

Este caso nos obriga a fazer perguntas difíceis:

- Quem é o verdadeiro “dono” de uma conversa com uma IA?

- Como podemos equilibrar o direito de uma pessoa de processar uma empresa por violação de privacidade com o direito à privacidade de todos os outros usuários dessa empresa?

- Nossas leis atuais, criadas em um mundo pré-IA, são suficientes para nos proteger?

A batalha está longe de terminar. Este é apenas um capítulo na longa e complexa saga sobre como a sociedade vai se adaptar e regular o poder da inteligência artificial. Para nós, usuários e entusiastas de tecnologia, fica a lição: a conveniência dessas ferramentas incríveis vem acompanhada de uma nova série de responsabilidades e questionamentos. Manter-se informado não é apenas uma curiosidade, mas uma necessidade para navegar com segurança neste admirável mundo novo.