ouvir o artigo

O Custo Secreto da IA: A Fome de Energia e Água por Trás do ChatGPT

Você já parou para pensar na mágica que acontece quando você faz uma pergunta ao ChatGPT ou gera uma imagem no Midjourney? Em segundos, uma resposta coesa ou uma obra de arte digital aparece na sua tela. Parece algo que saiu de um filme de ficção científica, mas essa tecnologia, a Inteligência Artificial (IA) generativa, tem um custo invisível e gigantesco. Por trás da fachada digital, existem verdadeiros titãs de metal e silício, os data centers, e eles estão consumindo recursos naturais em um ritmo alarmante. Vamos mergulhar no que realmente acontece nos bastidores e descobrir o preço oculto da revolução da IA.

O Apetite Voraz por Energia

Imagine um data center tradicional, aquele que hospeda sites, e-mails e armazena nossas fotos na nuvem. Ele já consome uma quantidade considerável de energia. Agora, imagine um data center projetado para IA. A escala é completamente diferente. O processo de dar vida a uma IA como o GPT-4 é dividido em duas fases principais: treinamento e inferência. O treinamento é a fase mais brutal. Envolve alimentar o modelo com uma quantidade colossal de dados da internet, forçando-o a aprender padrões, linguagem e lógica. Esse processo pode levar semanas ou meses e exige milhares de processadores superpotentes, as GPUs (Unidades de Processamento Gráfico), trabalhando sem parar. É como fazer um cérebro digital frequentar todas as bibliotecas do mundo ao mesmo tempo.

Depois vem a inferência. É o que acontece toda vez que usamos o serviço: fazemos uma pergunta, pedimos um resumo, geramos um código. Embora cada uma dessas tarefas consuma menos energia que o treinamento, a escala é o que impressiona. São milhões de usuários fazendo bilhões de perguntas todos os dias. Uma única consulta ao ChatGPT pode consumir quase dez vezes mais eletricidade que uma simples pesquisa no Google. Quando você soma tudo isso, a inferência acaba sendo responsável por mais da metade do consumo total de energia da IA. Um único servidor de IA, equipado com oito GPUs de ponta como a NVIDIA H100, pode consumir a mesma quantidade de energia que uma dúzia de residências.

A Sede Secreta da Inteligência Artificial

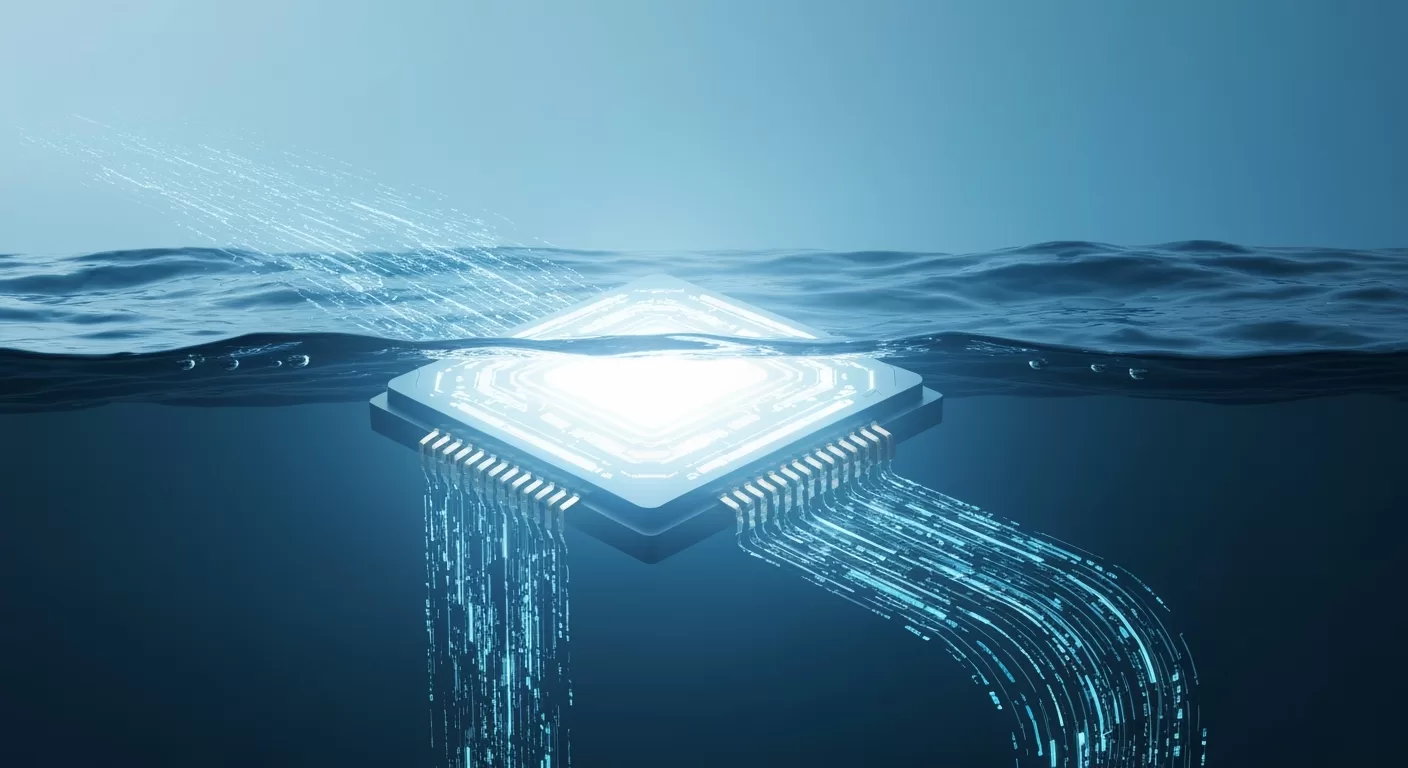

Se o consumo de energia é assustador, a quantidade de água que esses data centers bebem é ainda mais chocante. Todo esse poder de processamento gera uma quantidade imensa de calor. Para evitar que os servidores derretam, eles precisam ser resfriados constantemente. Um dos métodos mais comuns e eficientes é o resfriamento por evaporação. Funciona de forma parecida com o nosso suor: a água é bombeada para torres de resfriamento, onde evapora e leva o calor embora. O problema? Esse método consome volumes astronômicos de água potável.

Os números são de cair o queixo. Empresas como Google e Microsoft viram seu consumo de água disparar em mais de 20% e 30%, respectivamente, em apenas um ano, coincidindo com a explosão da IA. Estima-se que o treinamento do GPT-3 sozinho consumiu cerca de 700.000 litros de água. E no dia a dia? Uma conversa sua com o ChatGPT, com algo entre 10 a 50 perguntas e respostas, pode, metaforicamente, “beber” uma garrafa de 500 ml de água. O mais preocupante é que muitos desses data centers estão localizados em regiões que já sofrem com a escassez de água, criando um conflito direto entre o avanço tecnológico e as necessidades básicas das comunidades locais.

Existe um Futuro Mais Verde para a IA?

A boa notícia é que a indústria de tecnologia está ciente do problema e já busca soluções. A corrida não é apenas por IAs mais inteligentes, mas também por IAs mais eficientes. O que está sendo feito?

- Hardware mais eficiente: Empresas como NVIDIA e Intel estão em uma busca incessante por chips que ofereçam mais poder de processamento com menor consumo de energia.

- Modelos otimizados: Pesquisadores estão desenvolvendo técnicas para criar modelos de IA menores e mais “leves”, que exigem menos recursos para treinar e operar sem sacrificar a qualidade das respostas.

- Tecnologias de resfriamento inovadoras: O resfriamento líquido direto, que usa fluidos para absorver o calor diretamente dos chips, é muito mais eficiente e consome significativamente menos água do que os métodos tradicionais.

- Localização estratégica: Construir data centers em climas mais frios pode reduzir drasticamente a necessidade de resfriamento artificial, aproveitando o ar gelado do ambiente.

A era da Inteligência Artificial está apenas começando, e seu potencial para transformar nosso mundo é inegável. No entanto, essa jornada não pode ignorar seu impacto ambiental. O desafio para a próxima década será equilibrar a inovação com a sustentabilidade, garantindo que a inteligência que estamos construindo não esgote os recursos do planeta que todos compartilhamos. A verdadeira genialidade será criar uma IA que seja não apenas poderosa, mas também consciente.