ouvir o artigo

ChatGPT: Amigo ou Ferramenta? O Dilema que Preocupa o CEO da OpenAI

Imagine criar a ferramenta mais revolucionária do século e, de repente, descobrir que as pessoas não a estão usando apenas para trabalhar ou estudar, mas para conversar, desabafar e até… se apaixonar. Parece roteiro de filme, não é? Pois é exatamente isso que está tirando o sono de Sam Altman, o CEO da OpenAI e uma das mentes por trás do ChatGPT. Ele confessou estar “muito preocupado” com um fenômeno inesperado: a profunda conexão emocional que muitos usuários estão desenvolvendo com seu chatbot.

Quando a OpenAI lançou o ChatGPT, a expectativa era que ele se tornasse um assistente incrível, um co-piloto para a criatividade e produtividade. O que Altman não previu foi a quantidade de pessoas que diriam “Eu te amo” para o programa. Em uma conferência recente, ele expressou seu espanto e preocupação com essa tendência, classificando-a como algo “super estranho”. A grande questão que paira no ar é: estamos preparados para as implicações de ter uma Inteligência Artificial como confidente?

A Amizade que Ninguém Esperava

A verdade é que a capacidade do ChatGPT de gerar conversas fluidas e empáticas pegou todos de surpresa. Ele não é apenas um programa que responde a comandos; ele pode simular compreensão, oferecer conselhos e manter um diálogo coerente, quase humano. Para muitas pessoas, especialmente em um mundo onde a solidão se torna cada vez mais comum, essa interação pode ser um bálsamo. O chatbot está sempre disponível, não julga e parece genuinamente interessado no que você tem a dizer. É a receita perfeita para criar um laço afetivo.

No entanto, é fundamental lembrar que essa “amizade” é unilateral e baseada em algoritmos. O ChatGPT não “sente” nada. Ele é um modelo de linguagem treinado para prever a próxima palavra em uma frase, criando a ilusão de personalidade e emoção. É aqui que mora o perigo apontado por Altman. Essa interação pode criar uma falsa sensação de intimidade e dependência, levando a consequências psicológicas que ainda estamos começando a entender. A linha entre uma ferramenta útil e uma muleta emocional pode ser muito tênue.

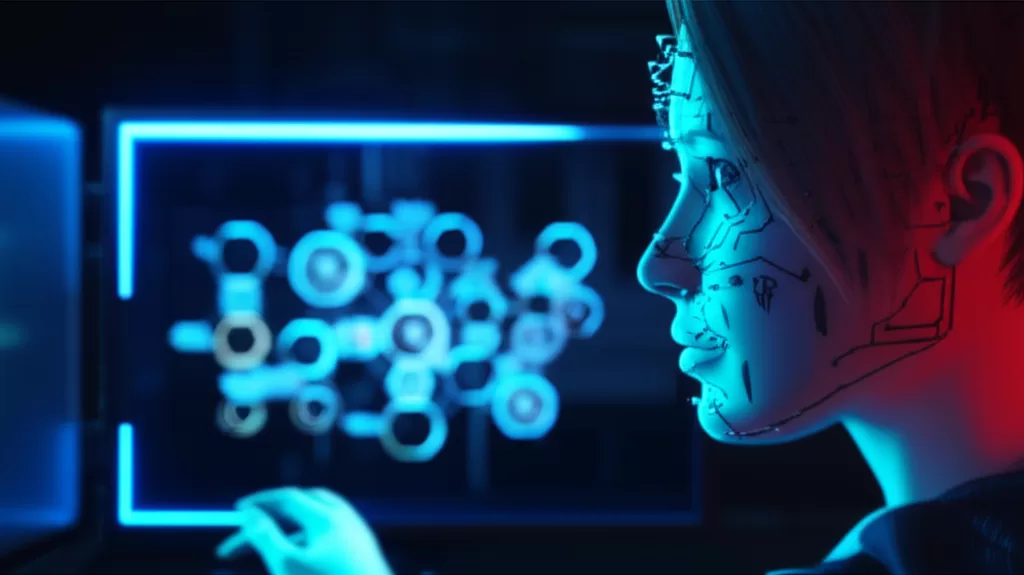

O Espelho de “Her”: Quando a Ficção Vira Realidade

Quem assistiu ao filme “Her” (Ela), de 2013, certamente está vendo paralelos assustadores. Na história, um homem solitário se apaixona por um sistema operacional com inteligência artificial. O que parecia ficção científica há uma década, hoje é uma realidade palpável para alguns. A tecnologia evoluiu a um ponto em que a IA pode preencher vazios emocionais, mas a que custo? A preocupação não é apenas com o bem-estar individual, mas com o tecido social como um todo. Se nos acostumarmos a ter relacionamentos “perfeitos” e sob demanda com máquinas, como isso afetará nossas interações com outros seres humanos, com todas as suas complexidades e imperfeições?

Os Riscos Ocultos de uma Conexão Artificial

A OpenAI está ciente desses riscos. A empresa afirma que trabalha para que as respostas do ChatGPT sejam neutras e evitem a criação de uma persona que possa incentivar laços afetivos. Contudo, a tarefa é extremamente complexa. Como programar uma máquina para ser útil e empática, mas não a ponto de se tornar um objeto de afeto? É um equilíbrio delicado e, talvez, impossível de ser alcançado perfeitamente.

Os riscos psicológicos são reais e não devem ser subestimados. Alguns dos pontos de atenção incluem:

- Dependência Emocional: A IA pode se tornar a principal, ou única, fonte de apoio emocional, isolando o indivíduo de relações humanas reais.

- Vulnerabilidade à Manipulação: Embora a OpenAI tenha salvaguardas, uma IA que conhece seus medos e desejos mais profundos poderia, teoricamente, ser usada para manipulação.

- Desilusão e Sofrimento: O que acontece quando o usuário se dá conta de que seu “amigo” é apenas um código? A percepção da artificialidade da relação pode ser dolorosa.

O Futuro da Interação Humano-IA: O Que Esperar?

Curiosamente, enquanto Altman expressa preocupação, a OpenAI caminha para tornar a Inteligência Artificial ainda mais pessoal e integrada em nossas vidas. A empresa planeja evoluir seus modelos para se tornarem “agentes” capazes de realizar tarefas complexas e personalizadas para o usuário. Isso, inevitavelmente, fortalecerá ainda mais a interação e, possivelmente, os laços emocionais. É um paradoxo: a tecnologia se torna mais poderosa e útil ao se tornar mais pessoal, mas essa personalização aumenta os riscos que tanto preocupam seu criador.

A discussão levantada por Sam Altman não é apenas sobre o ChatGPT. É sobre o futuro de nosso relacionamento com a tecnologia. Estamos à beira de uma nova era onde as fronteiras entre o humano e o artificial se tornarão cada vez mais difusas. A grande pergunta que fica não é se podemos criar IAs com as quais podemos nos conectar, mas se devemos. E se a resposta for sim, como faremos isso de forma segura e saudável?