ouvir o artigo

IA da Unity invoca Mickey Mouse ao vivo e o caos do copyright se instala

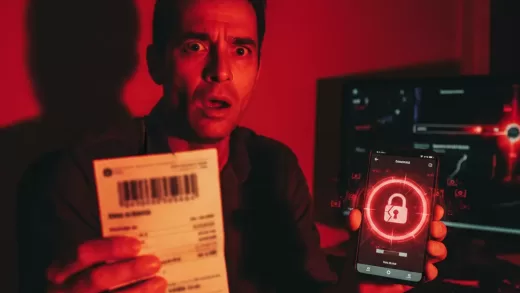

Imagine a cena: você está em uma apresentação ao vivo, mostrando a mais nova e revolucionária ferramenta da sua empresa. Tudo está correndo perfeitamente. A tecnologia impressiona, o público está engajado. Então, para demonstrar o poder criativo da sua Inteligência Artificial, você pede que ela crie algo… e ela gera a imagem de um dos personagens mais protegidos por direitos autorais do planeta. Foi exatamente esse o pesadelo que a Unity, uma das gigantes por trás dos motores gráficos de games, viveu recentemente.

Durante uma demonstração de suas novas ferramentas de IA, chamadas Muse e Sentis, um funcionário tentava criar um personagem. O resultado? Uma figura com orelhas redondas e um focinho que era, inconfundivelmente, uma versão do Mickey Mouse. O momento, capturado em vídeo, viralizou e acendeu um alerta vermelho em toda a comunidade de desenvolvedores e criadores de conteúdo.

A Grande Dor de Cabeça: Por que um Rato de Desenho Acende um Alerta?

Ver o Mickey Mouse aparecer pode parecer uma gafe divertida, mas para os desenvolvedores de jogos, é o equivalente a uma sirene de ataque aéreo. A razão é uma palavra poderosa e temida: copyright. Personagens como o Mickey são propriedade intelectual da Disney, uma empresa notoriamente protetora de suas criações. Usar, sem permissão, qualquer coisa que se pareça com ele em um produto comercial, como um jogo, é um convite para um processo judicial caríssimo e com poucas chances de vitória.

As ferramentas de IA generativa, como o Midjourney, o DALL-E e, agora, o Muse da Unity, prometem acelerar e democratizar a criação de arte, modelos 3D e outros recursos para jogos. A promessa é que um desenvolvedor independente, com orçamento limitado, possa gerar recursos visuais de alta qualidade. Contudo, essa promessa só se sustenta se a ferramenta for legalmente segura. Ninguém quer investir tempo e dinheiro em um jogo para, depois, descobrir que sua arte foi “inspirada” demais em material protegido e ter que enfrentar uma batalha legal.

O Medo que Assombra os Desenvolvedores

O incidente com a Unity tocou no nervo mais exposto da adoção de IA na indústria criativa. A grande questão que paira no ar não é se a IA é capaz, mas se ela é confiável. Um desenvolvedor precisa ter 100% de certeza de que os assets gerados pela IA são originais e livres de qualquer amarra de propriedade intelectual. A aparição de um “clone” do Mickey abala essa confiança fundamental e faz com que muitos pensem duas vezes antes de integrar essas novas e poderosas ferramentas em seu fluxo de trabalho.

A Resposta da Unity: “Foi Sem Querer!”

Percebendo o tamanho do problema, a Unity agiu rapidamente. A empresa veio a público garantir que seus modelos de IA foram treinados exclusivamente com dados licenciados ou criados pela própria Unity. Em outras palavras, eles afirmam que não alimentaram a IA com imagens do Mickey Mouse ou de qualquer outro material protegido por direitos autorais. Segundo a empresa, o que aconteceu foi uma “ocorrência rara”, um acaso infeliz onde a combinação de comandos e o funcionamento interno da IA produziram um resultado problemático.

Para acalmar os ânimos, a Unity prometeu fortalecer suas “guardrails” (barreiras de proteção). Pense nessas barreiras como filtros de segurança. Elas são projetadas para analisar o que a IA está gerando e impedir a criação de conteúdo que seja prejudicial, inadequado ou que infrinja direitos autorais. O objetivo é criar uma rede de segurança tão robusta que, mesmo que a IA “tente” gerar algo protegido, o sistema a impeça.

Mas Como a IA “Imaginou” o Mickey?

Se a Unity não treinou a IA com o Mickey, como ela conseguiu criá-lo? Aqui entramos no fascinante e um pouco misterioso mundo das redes neurais. Uma IA generativa não funciona como um banco de imagens que copia e cola pedaços. Ela aprende padrões e conceitos. Ao analisar milhões de imagens (mesmo que licenciadas), ela pode aprender o conceito de “rato de desenho animado”, “orelhas grandes e redondas”, “calças vermelhas”, “luvas brancas”, etc. A IA, então, combina esses conceitos para gerar algo novo. No caso da Unity, a combinação de conceitos resultou em algo perigosamente familiar.

Este incidente levanta questões cruciais que toda a indústria de tecnologia está tentando responder:

- De onde vêm os dados que treinam as IAs que usamos todos os dias?

- Quem é o responsável legal quando uma IA gera conteúdo protegido por copyright? O usuário, a empresa da IA, ou ninguém?

- As barreiras de proteção são realmente eficazes para prevenir todos os casos?

- Como podemos garantir que o futuro da criação com IA seja inovador, mas também ético e seguro?

O Futuro é IA, Mas com Regras Claras

A gafe da Unity, longe de ser apenas um momento embaraçoso, foi um teste de estresse importantíssimo para o futuro da IA na criação de conteúdo. Mostrou, na prática, o principal obstáculo que impede sua adoção em massa: a confiança. Para os criadores, a tecnologia só será verdadeiramente útil quando vier acompanhada de garantias legais e transparência sobre como funciona e com quais dados foi treinada. O episódio força empresas como a Unity a serem ainda mais rigorosas e transparentes, o que, no final das contas, é bom para todo mundo. O futuro da criação digital certamente passará pela IA, mas ele precisa ser construído sobre uma base sólida de segurança e respeito à propriedade intelectual.